AI 更新速度真的快到有點誇張。前陣子 OpenClaw 才剛爆紅,Anthropic 就跟著推 Claude Dispatch,GitHub 也上了 Agent 跟 Copilot CLI delegate。現在基本上每家大廠都在推自家的遠端服務,開源社群裡也冒出一堆綁定 Telegram 或 LINE 來做客製化 AI Agent 的專案。

自從 ACP (Agent Client Protocol) 還有 CDP (Chrome DevTools Protocol) 這些底層協議出來後,開發者的自由度變得超大。想接 Cloud Code、Codex 還是 Copilot CLI,走 ACP 就能搞定。而 CDP 更是直接讓 AI 拿到操控瀏覽器的能力,給它一個 Sandbox 環境,它就能幫你訂機票、查飯店甚至下單。這股風潮已經燒到連非開發者都在狂用這類自主型 AI。

1. 叫 AI 寫個 Agent 門檻變低了,但踩到的坑呢?

其實我自己也有弄了一版類似的工具。說真的,現在做 Agent 門檻真的低,隨便拿 Telegram 當橋接,底層靠 ACP (Agent Client Protocol) 把指令打通,剩下的直接叫 AI 幫忙寫一寫,一隻能在本機跑的 Agent 很快就生出來了。

但實際跑下去,馬上踩到兩個大坑:

第一:完全沒有安全邊界。當初因為不想花錢買伺服器架在雲端,想說直接跑在本機最省事。但這其實不是 ACP 的鍋(畢竟很多 Star 高的專案也都在用),問題出在本地執行環境的控管。成熟的專案通常會搭配 Sandbox 或是嚴格的權限審查,但我自己快速用 AI 兜出來的版本根本沒做這些防護。讓 Agent 直接在主機環境隨意下指令,它基本上可以把你的電腦翻過來,風險極高。

第二:資源消耗跟維護成本。雖然靠 Vibe Coding 快速弄出來的 Agent 會動,但背景一跑起來,那資源吃得滿有感的。加上網頁環境變來變去,動不動就要手動介入去修 Bug。後來想想,與其自己硬扛一個要一直顧的本地服務,不如去用社群裡穩定維護的專案,把架構拆乾淨一點。

2. 重新看底層:為什麼直連 CDP,而不是 Playwright?

因為前面踩過效能的坑,後來在規劃自動化專案時,我重新看了一下底層技術。說到瀏覽器自動化,大家第一個想到的通常是 Playwright,但拿來做 AI Agent,Playwright 的抽象層其實太厚了。

大家都知道 Playwright 主要是拿來做「傳統自動化測試」的,底層多包了一層 Node.js 中轉。但 AI Agent 在逛網頁時,常常要狂抓 DOM 樹、查座標或盯著跨源 iframe。中間卡一個 Playwright 來回溝通,延遲被放大不說,還很吃資源。這也是為什麼現在最前沿的 AI 團隊(像是 Browser Use)都開始棄用 Playwright,直接轉向 CDP。

在我的新專案裡,我也是選在 Local Python 環境直接透過 CDP 跟瀏覽器對話。Closer to the Metal(貼近底層)的做法,直接換來了極致的效能,還有對動態網頁的控制力。

3. 知識落地的最佳載體:Obsidian

抓資料的效能搞定了,那資料要存哪?Andrej Karpathy 提倡的「基於 Obsidian + AI Agent 的個人知識庫」給了很棒的答案。

為什麼是 Obsidian?因為它夠純粹。底層就只是 Markdown,人好讀,對 AI 來說也是最乾淨的介面。不用像其他軟體還要搞 MCP 串接,在本地端只要把 AI Agent 的路徑對準這個 Vault,它就能直接讀寫。再配上 Graph View 或是 MOC (Map of Content) 的玩法,看著那些節點連線長成自己的資料庫,成就感很高。

4. 實戰:有紀律的自動化知識流程

不過,很多人在吵說直接把網路生肉(Raw Data)餵給 AI,再反哺生出來的 Wiki 到底有沒有價值?說真的,把完全沒篩選過、自己連看都沒看過的資料直接倒進資料庫,我也覺得不行。這套流程我自己目前也還在持續摸索跟嘗試,但目前最大的體悟是:如果不切開架構,最後只會得到一堆垃圾訊息。

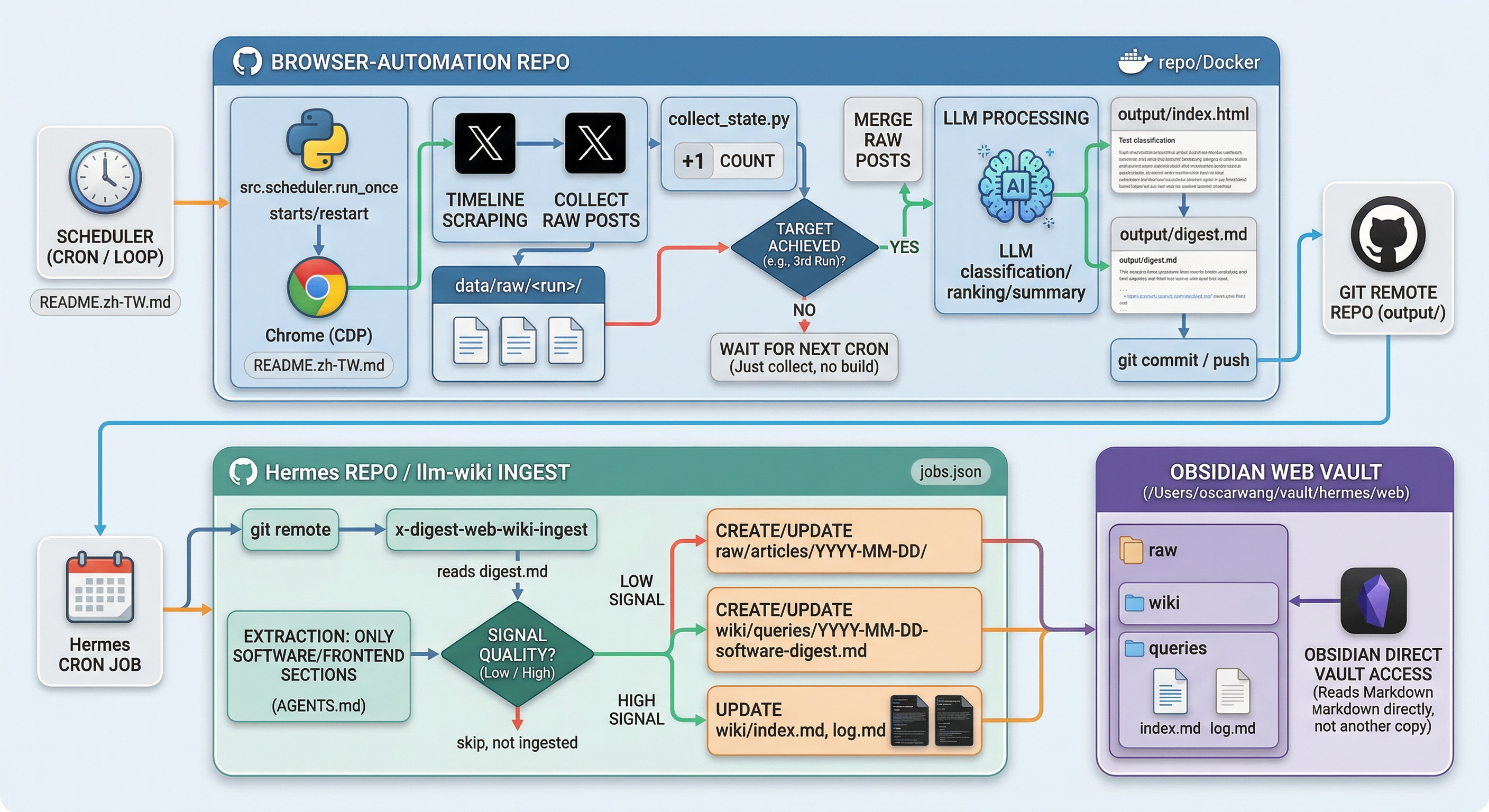

結合前面的 CDP 跟輕量化原則,我寫了 browser-automation 這個專案。

- 自動採集與中介層:系統定時去抓 X 上的貼文。當天累積到目標次數,就打包輸出

digest.md並 push 上去。這份 digest 就是給 Agent 吃的「乾淨中介層」,把重活交給外部排程,不讓我的筆電資源狂飆。 - 品質門檻 (Quality Gate):本地的 Hermes 排程固定去讀 digest 檔。它不會全收,會先判斷這則訊號「值不值得留」。

- 從源頭徹底隔離:這點最重要。我從網路抓下來的東西,就算過了篩選、更新到目錄裡,也絕對不會混進我個人的資料庫。因為我從一開始就把它切開了——這個自動化流程寫入的資料庫(Vault),跟我私人的筆記庫是完全分開的。從源頭物理隔離,防止資料污染。

結語:當個資料守門員

現在一堆人鼓吹有了 Agent,知識管理就可以外包給 AI 幫你弄到好,這其實滿危險的。

AI 確實能用 CDP 幫你無腦抓資料、寫摘要,但它沒辦法幫你決定「知識庫的整體架構」。如果邊界沒設好、沒做過濾,甚至不去管底層效能,放任 AI 亂跑只會是一場災難。我們現在確實不用再當苦命抄筆記的打字員了,但這不代表技術門檻不見了,而是要求我們往上走,去當那個掌控架構跟品質的守門員。